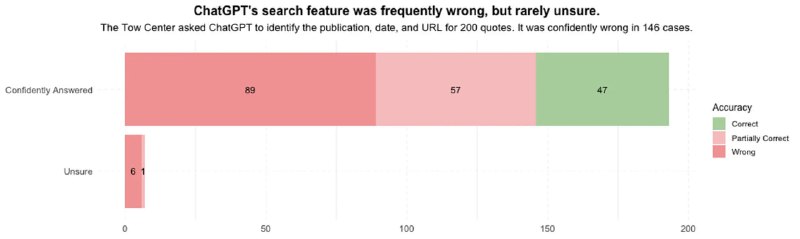

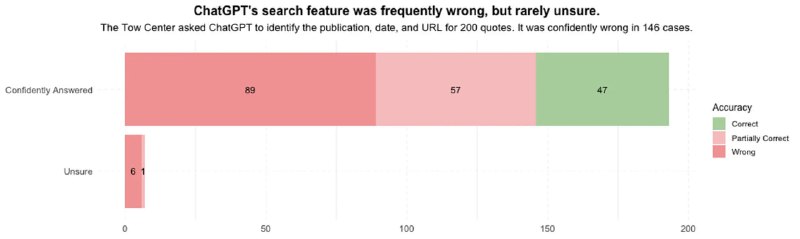

Исследование, проведенное Центром цифровой журналистики Тоу при Колумбийском университете, выявило неожиданные недостатки в поисковых возможностях ChatGPT.

В ходе эксперимента эксперты проверили, как хорошо чат-бот справляется с поиском источников 200 цитат из различных изданий. Результаты оказались достаточно печальными.

Команда обнаружила, что в 153 случаях ChatGPT предоставил неверную или частично некорректную информацию. При этом бот всего 7 раз признал свою неопределенность, используя выражения вроде «возможно» или «не смог найти точную статью».

Интересно, что из 40 цитат, которые были взяты из изданий с закрытым доступом для поискового робота OpenAI, ChatGPT всё равно предоставил ошибочную информацию о источниках.

Некоторые ошибки были весьма серьезными. Например, при запросе источника цитаты из New York Times о угрозе исчезновения китов, он привел ссылку на сайт, просто копирующий эту статью.

OpenAI отреагировала на результаты исследования сдержанно, назвав их «нетипичным тестом» и пообещав улучшения в будущих версиях.

Таким образом, журналисты подтвердили уже давно существующее мнение: использование нейросетей для поиска информации по-прежнему может быть рискованной затеей.

Источник: @droidergram