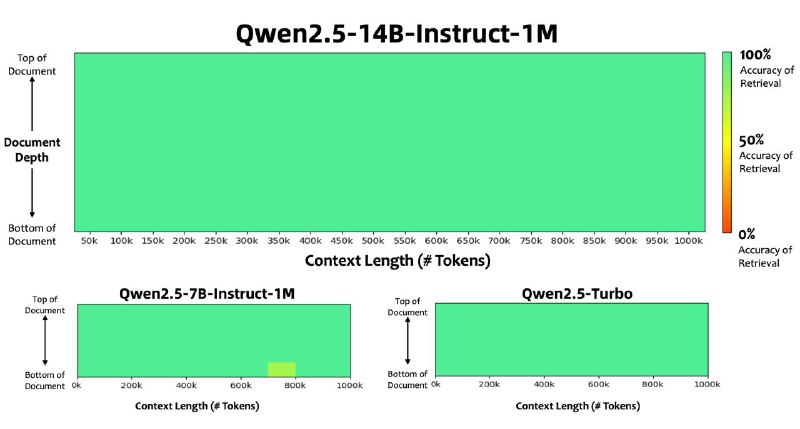

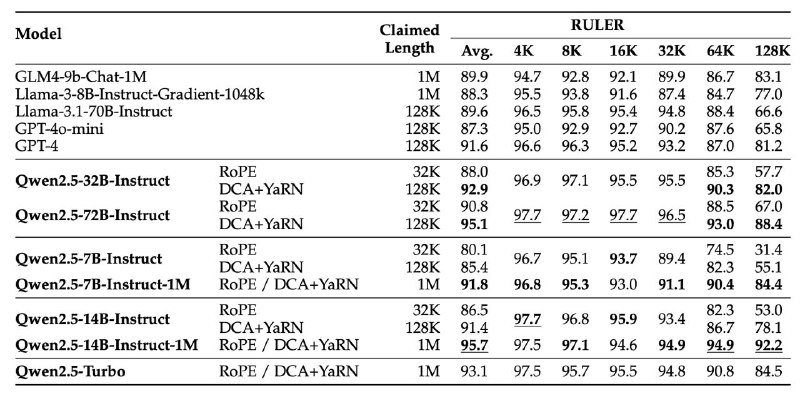

Представлена новая модель Qwen2.5-1M, способная обрабатывать контекст на уровне 1 миллиона токенов, что позволяет загружать в чат целые книги и задавать по ним вопросы.

Для сравнения, модель DeepSeek V3 имеет контекстное окно всего в 128 тысяч токенов, тогда как ожидаемая модель OpenAI o3-mini будет поддерживать около 256 тысяч токенов, когда выйдет.

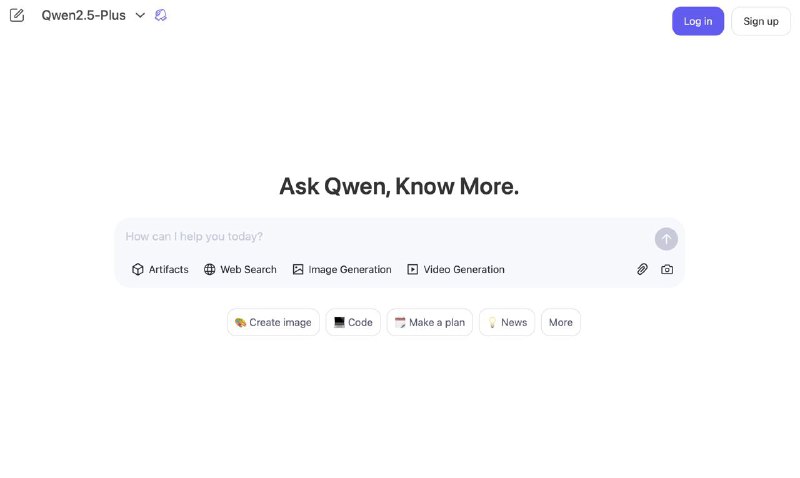

Использование Qwen2.5-1M является бесплатным и доступно через веб-браузер. Среди возможностей данной модели — написание кода, веб-поиск, а также генерация изображений и видео.

Источник: @typespace