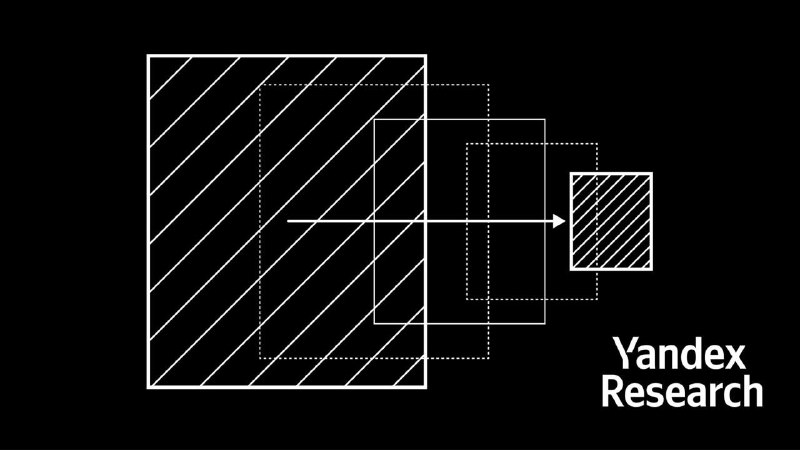

Исследователи из «Яндекса» в сотрудничестве с ВШЭ и Массачусетским технологическим институтом предложили способ, позволяющий эффективно сжимать текстовые нейросети без потерь.

Метод, известный как HIGGS, осуществляет квантование больших языковых моделей, что позволяет уменьшать их размеры без необходимости дообучения или сложной настройки параметров. Это можно реализовать непосредственно на таких устройствах, как смартфоны или ноутбуки.

С помощью данной методики уже сжаты крупные модели, такие как DeepSeek-R1 и Llama 4 Maverick, которые обычно требуют специализированного серверного оборудования.

Источник: @rozetked