Новое обновление DeepSeek-V3 предлагает улучшенные возможности написания кода, расширяя контекст до 128K токенов и внедряя архитектуру Mixture of Experts с 671 миллиардом параметров.

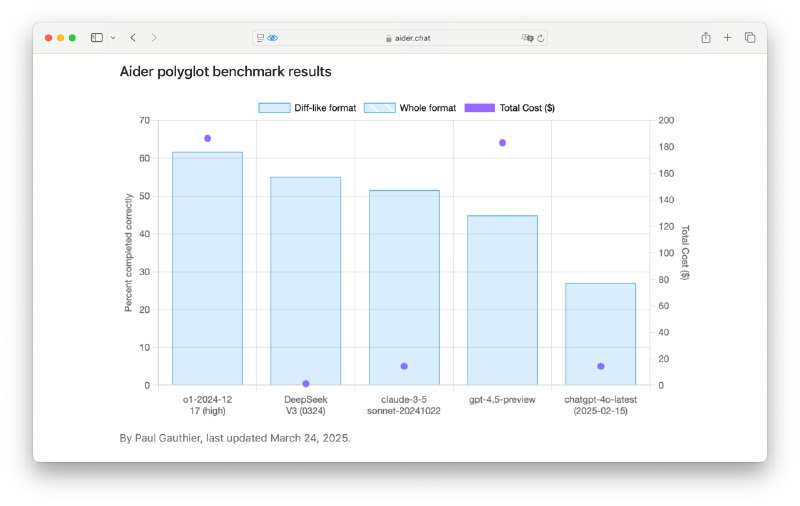

По результатам бенчмарка версия DeepSeek-V3 0324 достигла 48,4%, обойдя такие модели, как Claude 3.5 Sonnet и GPT-4.5. Лишь модель o1 показала лучшие результаты.

Обучение модели оказалось значительно дешевле: $6 миллионов против $78 миллионов на GPT-4 при аналогичной продуктивности.

Опробовать обновленную модель можно бесплатно.

Источник: @typespace